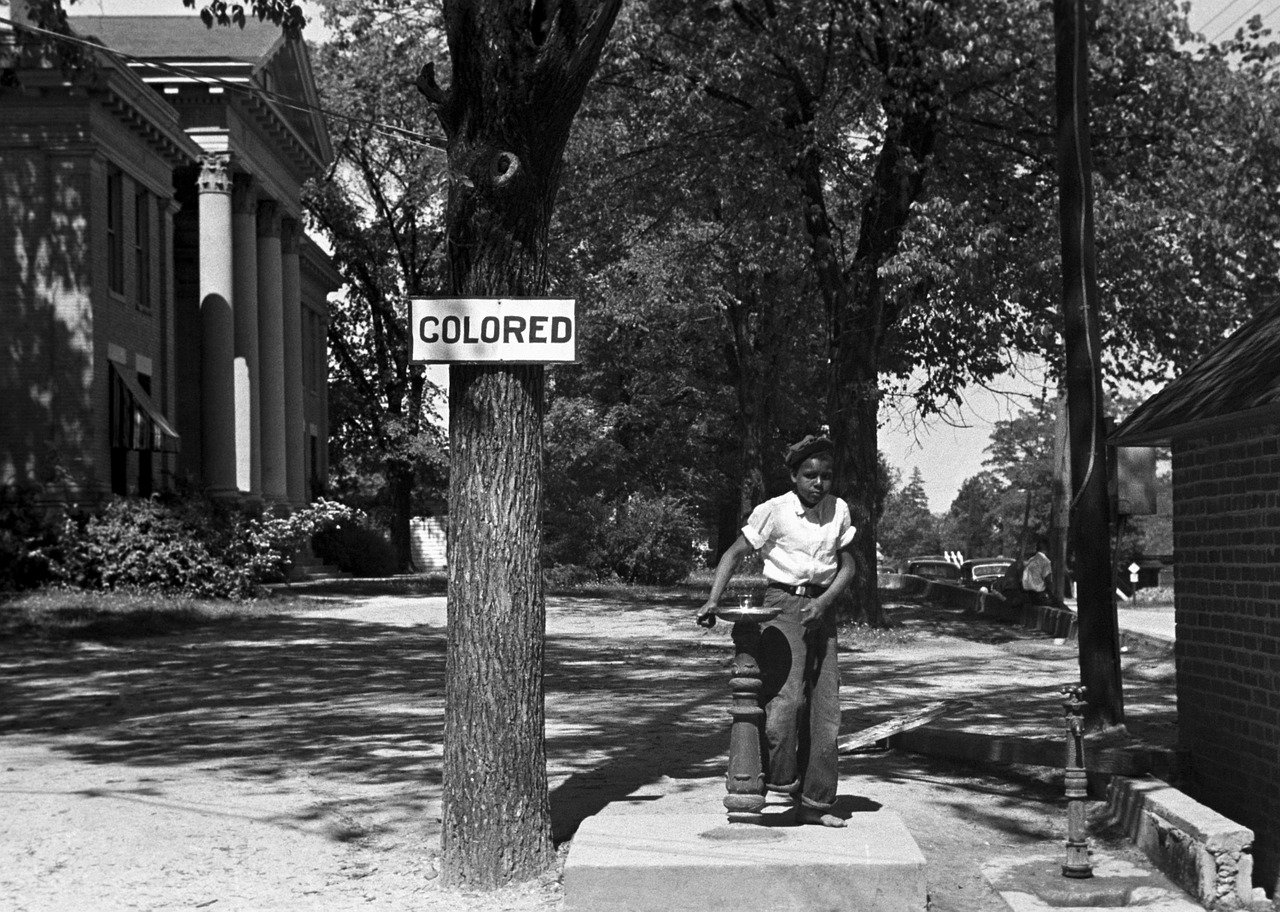

“Siamo sempre lo straniero di qualcun altro”. Pare sia una saggia frase di Tahar Ben Jelloun, scrittore marocchino in passato candidato al Nobel per la letteratura, ma poiché il nome è parecchio difficile la frase viene attribuita un po’ qui ed un po’ lì. È una di quelle frasi tanto vere e di buon senso che amiamo ripeterci, a turno. Perché noi siamo quelli buoni, integrati e senza pregiudizi. Quelli che sanno che è parecchio stupido fare liste alla lavagna, e soprattutto farle per colore, etnia o classe.

Tutto molto bello, come direbbe il grande Bruno Pizzul.

O quasi. La verità è che siamo degli sporchi razzisti, dei discriminatori. O, per essere meno severi, siamo semplicemente delle persone così umane da non avere ancora superato il pregiudizio, E da averlo tramandato non solo da padre in figlio, ma anche da programmatore a robot. Per cui siamo qui, anno 2018, droni che consegnano la spesa, voli su Marte e razzismo ovunque. Ancora.

Un semplice test

Steve è molto timido e chiuso. Sempre disponibile, ha però scarso interesse per le persone o il mondo della realtà. Anima mite e precisa, ha bisogno di ordine e struttura, e una passione per il dettaglio. È più probabile che sia un bibliotecario o un agricoltore?

La risposta più probabile, sulla base del numero di individui appartenenti all’una o all’altra categoria, è “agricoltore”: per ogni bibliotecario ci sono almeno venti contadini, dunque la descrizione si attaglia più facilmente al gruppo più ampio (e quindi più variegato), anche se composto da “rozzi” coltivatori. O almeno, questo sostiene Daniel Kahneman (suo il virgolettato da Pensieri lenti e veloci).

Pochissime persone applicano un calcolo delle probabilità alla domanda “bibliotecario o agricoltore?”. Pochissimi ritengono saggio scommettere su “agricoltore” in virtù di una spropositata statistica a favore della categoria. Anche oggi è più facile attribuire caratteristiche quali l’ordine e l’animo mite a un bibliotecario.

Siamo fatti così, “persone dotate di passioni e pregiudizio”, per dirla con Dale Carnegie. Lo siamo ancora. Se tu, genitore, pensi che il tizio rozzo sia un contadino, che il terrorista sia islamico, che il ladro sia nero, è probabile che tuo figlio la penserà allo stesso modo. Dico “probabile”, ma a ben guardare verrebbe da dire “sicuro”.

Nelson Mandela in proposito disse: “Nessuno è nato odiando qualcun altro per il colore della pelle, o il suo ambiente sociale, o la sua religione. Le persone odiano perché hanno imparato a odiare.”

È davvero così. Anche nell’era digitale. Anche nel caso di Google e di altri robot.

Il pregiudizio al tempo di Google (e dei robot)

In principio fu una foto. Un giovane di colore (occhio, non ho detto nero!), utilizzando Google Photo, trovò la sua amica etichettata come gorilla.

Era il 2015, e si alzò un polverone che mise in forte imbarazzo la società di Mountain View e iniziò a far riflettere un po’ tutti, anche quelli convinti dell’imparzialità di un motore di ricerca.

Per la cronaca – storia recentissima – ho provato anch’io, prima di scrivere questo pezzo, e la situazione non è stata risolta. O meglio: è stata risolta in modo razzista. Wired ad esempio ha raccontato di aver provato a effettuare ricerche con centinaia di foto e di aver ottenuto sempre zero risultati per il termine “gorilla”, anche se nelle foto ne erano presenti diversi esemplari, volutamente inseriti. Si può insomma trovare primate, o babbuino, o orango tango, ma non gorilla o scimpanzé.

Ma come si dice, il meglio – o il peggio – doveva ancora venire. Un libro recente, Algorithms of Oppression: How Search Engines Reinforce Racism, di Safiya Umoja Noble, mette in luce qualcosa di più inquietante.

Safiya Umoja Noble mette in discussione l’assunto che i motori di ricerca come Google offrano condizioni paritarie a tutte le forme di idee, identità e attività. La discriminazione basata sui dati è un vero problema sociale; Noble sostiene che la combinazione di interessi privati nella promozione di alcuni siti, in aggiunta allo status monopolistico di un numero relativamente limitato di motori di ricerca su Internet, porta a degli algoritmi di ricerca faziosi, che privilegiano tutto ciò che è bianco discriminando di rimando le persone di colore, in particolare le donne di colore.

Tramite un’analisi delle ricerche, sia testuali che dei media, nonché una ricerca approfondita sulla pubblicità online a pagamento, Noble porta alla luce una cultura del razzismo e del sessismo nel modo in cui viene a formarsi il concetto di reperibilità dei contenuti online (che lei definisce “scopribilità”).

In un mondo in cui i motori di ricerca e le loro rispettive società hanno sempre più importanza – come risorsa primaria per la messaggeria elettronica, per l’insegnamento nelle scuole elementari e nell’educazione secondaria – diventa estremamente importante comprendere e invertire queste tendenze inquietanti e queste pratiche discriminatorie.”

(estratto da nyupress.org)

L’esempio dal quale parte, che rende meglio l’idea, è una semplice ricerca su Google. Prova a digitare “ragazze nere” e “ragazze bianche” e trova la differenza.

Lo stesso vale anche al di là dello sfondo sessuale. Siamo tutti spettatori, più o meno consapevoli, quando cerchiamo mamma, o papà, o mamma e papà: sono quasi sempre bianchi. Accade perché noi siamo bianchi, e forse perché, come dice Safiya, anche i programmatori e i contributori sono quasi sempre bianchi.

È vero insomma che “siamo sempre lo straniero di qualcun altro”, ma è palese che ci siano stranieri e stranierastri, che regole e pregiudizi siano duri da battere.

Da padre in figlio, da programmatore a robot

Machine learning è un modo elegante per dire “trovare schemi nei dati”. Come raccontato dal Guardian, rapporti recenti hanno dimostrato che i sistemi di apprendimento automatico stanno raccogliendo idee razziste e sessiste.

Già nel 1986, la scuola medica dell’ospedale St. George di Londra fu dichiarata colpevole di discriminazione razziale e sessuale quando automatizzò il processo di ammissione basato sui dati raccolti negli anni ’70. Il programma ha esaminato il tipo di candidati che avevano avuto successo in passato e ha rilasciato interviste a persone simili. Non sorprendentemente, le persone ritenute idonee dal computer erano maschi e avevano nomi che sembravano anglosassoni.

Ma il caso più eclatante è del 2016, frutto di una previsione razzista a proposito della possibilità di recidiva criminale. Ecco la storia: nel 2014, Brisha Borden era in ritardo per prendere la sua piccola a scuola e rubò una bicicletta. Fu preso. Più o meno nello stesso periodo, il quarantanovenne Vernon Prater è stato arrestato per un furto di $ 86,35 in un negozio. Prater aveva precedenti e dunque scontò una pena molto più dura, ben cinque anni di carcere. Eppure quando Borden e Prater furono incarcerati, un programma predittivo diede il seguente risultato: Borden ad alto rischio, Prater a basso rischio.

Adesso indovinate chi era quello nero.

Manipolazione di massa: la responsabilità è nostra

Nel 1980 il sociologo Langdon Winner, in Do Artifacts Have Politics?, analizza il nesso tra razzismo e design di alcuni ponti costruiti sulle strade di Long Island.

Molti di questi ponti erano estremamente bassi, con appena nove piedi di spazio dal marciapiede. La maggior parte delle persone difficilmente attribuirebbe un significato speciale al loro design, tuttavia Winner suggerì che fossero in realtà un’incarnazione dei pregiudizi sociali e razzisti del designer Robert Moses, il responsabile della costruzione di molte strade, parchi, ponti, e altre opere pubbliche a New York tra gli anni ’20 e ’70.

Winner scrisse che con i ponti bassi l’intenzione di Moses era di consentire l’accesso al parco pubblico solo ai bianchi di classe “alta” e “medio-alta”, poiché costituivano diffusamente le uniche parti della popolazione in grado di permettersi le auto in quel momento. Poiché gli individui più poveri (che includevano molte persone di colore) facevano affidamento su autobus pubblici più alti, gli era stato negato l’accesso al parco, poiché questi autobus non erano in grado di superare i cavalcavia bassi e quindi erano costretti a trovare percorsi alternativi.

Come ricorda in seguito l’urbanista di New York Lee Koppleman, “Il vecchio figlio di… si assicurò che gli autobus (e i neri) non sarebbero mai stati in grado di usare le sue maledette strade”.

(come riportato da Luke Dormehl su digitaltrends)

Il problema non è nuovo, dunque. Non è colpa di Google, o di Internet, o del digitale, o dei robot. Il problema è che il digitale, Internet, l’automazione e l’Ai, invece, possono darci una grossa mano per combattere il pregiudizio e il razzismo. Ma, come dice Kristian Lum di Human Rights Data Analysis Group (HRDAG), “Se non si fa attenzione, si rischia di automatizzare proprio gli stessi pregiudizi che questi programmi dovrebbero eliminare”.

Se Moses si assicurò “meno neri nei parchi”, il risultato è oggi più inquietante. Un recente rapporto della Brandeis University ha rilevato che “il divario tra ricchezza in bianco e nero è quadruplicato tra il 1984 e il 2007, rendendo i bianchi cinque volte più ricchi dei neri negli Stati Uniti.”

Da padre in figlio, da programmatore in figlio, da umano a robot, di chi è la colpa e di chi è la responsabilità? Dire loro è un pregiudizio; dire nostra un passo avanti.